在AI大模型百花齐放的今天,开发者常面临一个难题:不同厂商的API协议差异导致开发效率低下。

例如调用ChatGPT需要遵循OpenAI的规范,而接入讯飞星火则需完全不同的参数结构。今天给大家推荐一款项目 One API,这个项目正是为解决这一痛点而生。它如同AI领域的”网关”,将分散的大模型API统一转化为标准OpenAI格式,让开发者以一套代码兼容数十种主流大模型。

核心功能

1. 多模型统一接入

One API目前已支持超过30种大模型服务,涵盖国内外主流AI厂商:

-

国际模型:OpenAI全系列(含Azure)、Google PaLM2/Gemini、Anthropic Claude、Meta Llama等 -

国产模型:讯飞星火、智谱ChatGLM、百度文心一言、阿里通义千问、360智脑等 -

开源模型:通过集成Ollama可接入本地部署的ChatGLM3、Qwen、DeepSeek等模型

2. 企业级管理功能

-

密钥分发:支持二次分发管理API密钥,可设置额度、有效期和IP白名单 -

负载均衡:自动在多个同类型渠道间分配请求,提升系统稳定性 -

数据监控:实时查看各渠道的调用量、响应时间和错误率 -

审计日志:记录所有API请求的详细元数据,满足企业合规需求

3. 开发者友好特性

-

无缝兼容:现有基于OpenAI SDK的应用只需修改 base_url即可迁移 -

流式传输:完整支持Chat Completions的stream模式,实现打字机效果 -

模型映射:将私有模型名称映射为通用标识(如将”qwen-max”映射为”gpt-4″)

实战案例

5分钟接入私有化大模型

案例背景

某企业希望将本地部署的ChatGLM3接入现有AI知识库系统,但原有系统仅支持OpenAI接口。

实现步骤:

部署ChatGLM3服务

# 使用chatglm.cpp加速CPU推理

docker run -p 8000:8000 liplusx/chatglm.cpp uvicorn api:app --host 0.0.0.0:cite[6]

配置One API渠道

-

类型选择OpenAI兼容 -

代理地址填写 http://内网IP:8000 -

模型名称映射为” gpt-3.5-turbo”

修改应用配置

# 原OpenAI配置

OPENAI_API_BASE = "https://api.openai.com/v1"

# 改为One API地址

OPENAI_API_BASE = "http://one-api:3000/v1"

界面展示

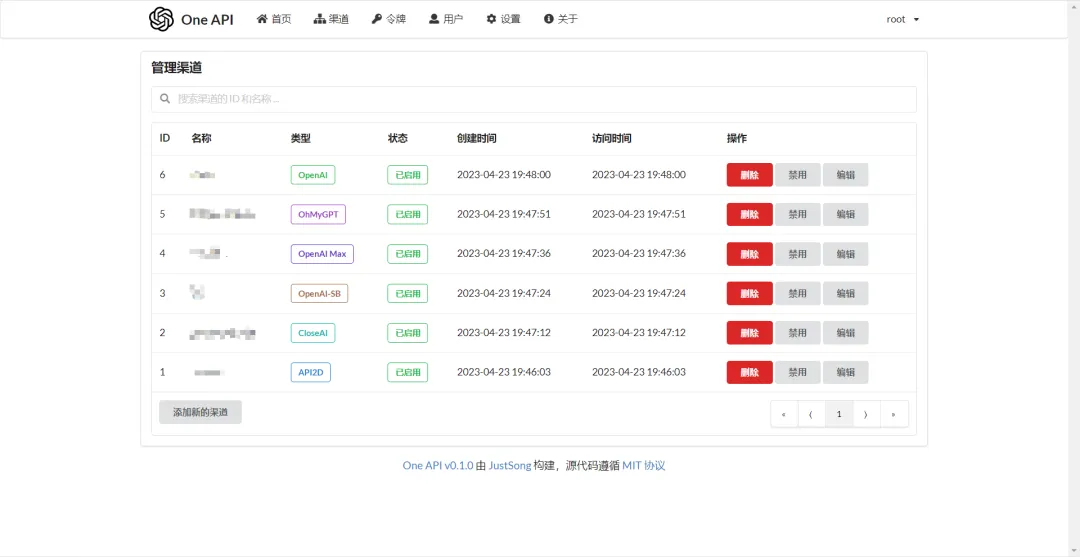

渠道列表

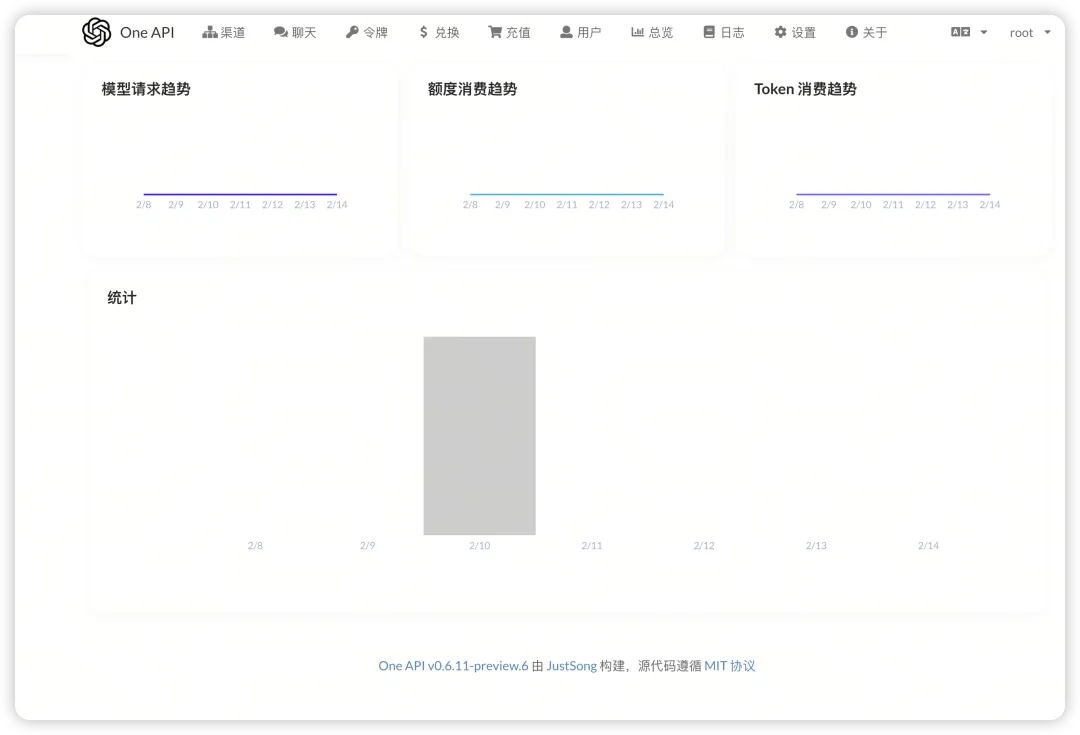

监控页面

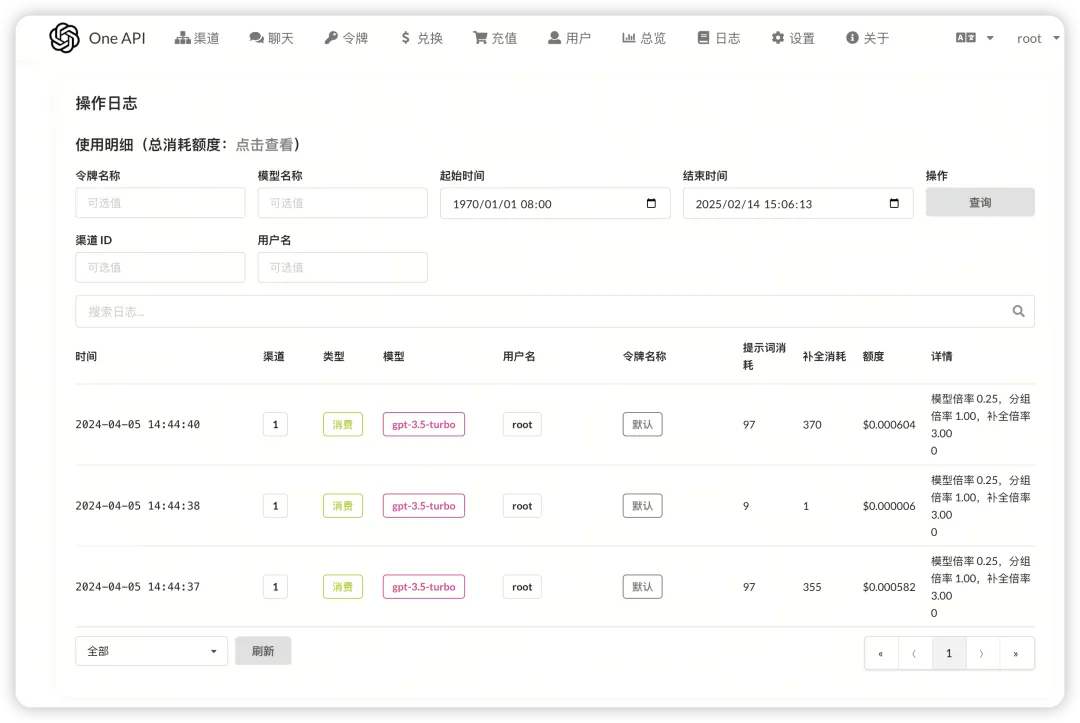

操作日志

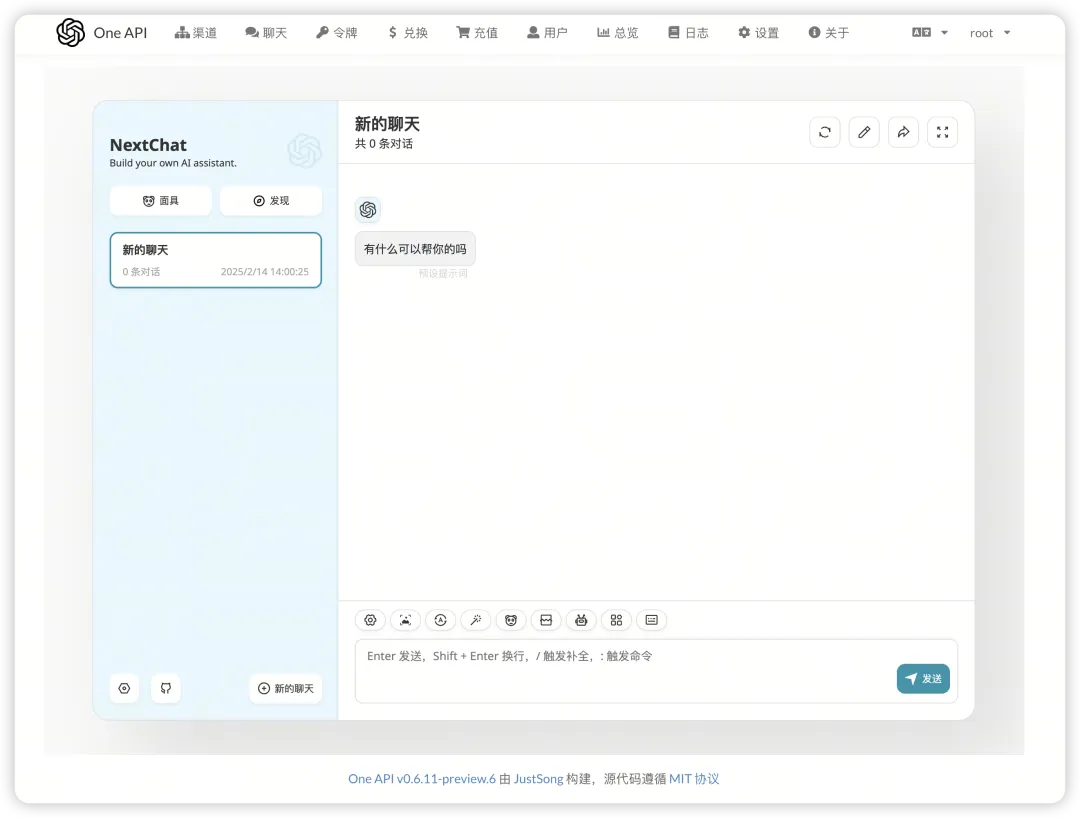

对话页面

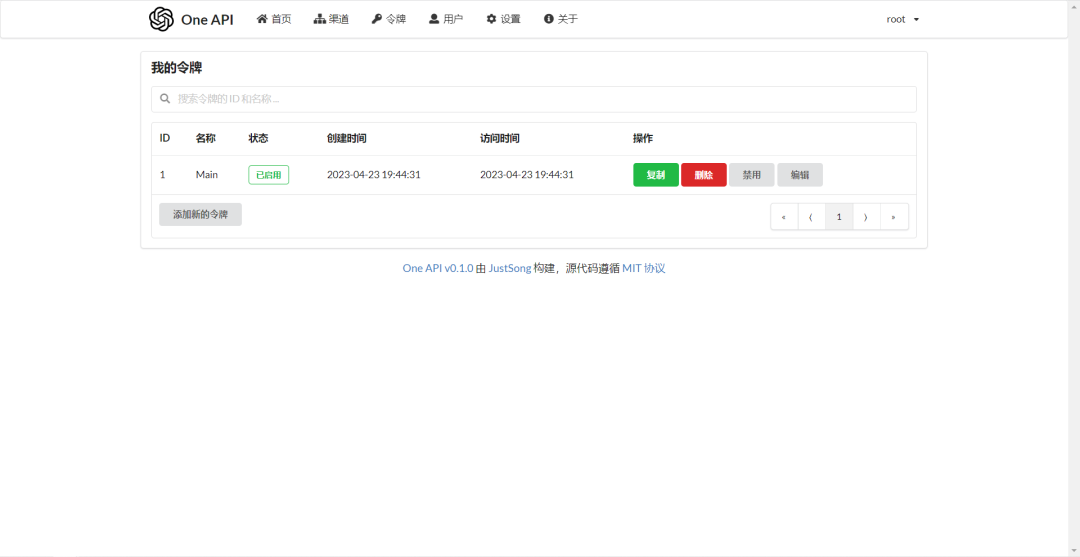

令牌页面

版权声明:

1、本网站名称:帝企吧

2、本站永久网址:https://www.diqiba.com

3、本网站的文章部分内容可能来源于网络及作者投稿,仅供大家学习与参考,如有侵权,请联系站长进行删除处理。

4、本站一切资源不代表本站立场,并不代表本站赞同其观点和对其真实性负责。

5、本站一律禁止以任何方式发布或转载任何违法的相关信息,访客发现请向站长举报。

6、本站资源大多存储在云盘,如发现链接失效,请联系我们我们会第一时间更新。

7、本站所有资源来源于互联网,仅用于学习及参考使用,切勿用于商业用途,如产生法律纠纷本站概不负责! 8、资源除标明原创外均来自网络转载,版权归原作者所有,若侵犯到您权益请联系我们删除,我们将及时处理! 9、若您需使用非免费的软件或服务,请购买正版授权并合法使用!

1、本网站名称:帝企吧

2、本站永久网址:https://www.diqiba.com

3、本网站的文章部分内容可能来源于网络及作者投稿,仅供大家学习与参考,如有侵权,请联系站长进行删除处理。

4、本站一切资源不代表本站立场,并不代表本站赞同其观点和对其真实性负责。

5、本站一律禁止以任何方式发布或转载任何违法的相关信息,访客发现请向站长举报。

6、本站资源大多存储在云盘,如发现链接失效,请联系我们我们会第一时间更新。

7、本站所有资源来源于互联网,仅用于学习及参考使用,切勿用于商业用途,如产生法律纠纷本站概不负责! 8、资源除标明原创外均来自网络转载,版权归原作者所有,若侵犯到您权益请联系我们删除,我们将及时处理! 9、若您需使用非免费的软件或服务,请购买正版授权并合法使用!

评论(0)