在元宇宙、虚拟现实和游戏产业蓬勃发展的今天,3D数字人技术已成为连接虚拟与现实的桥梁。然而,传统3D建模流程对专业设备与技术的依赖,让许多创作者望而却步。

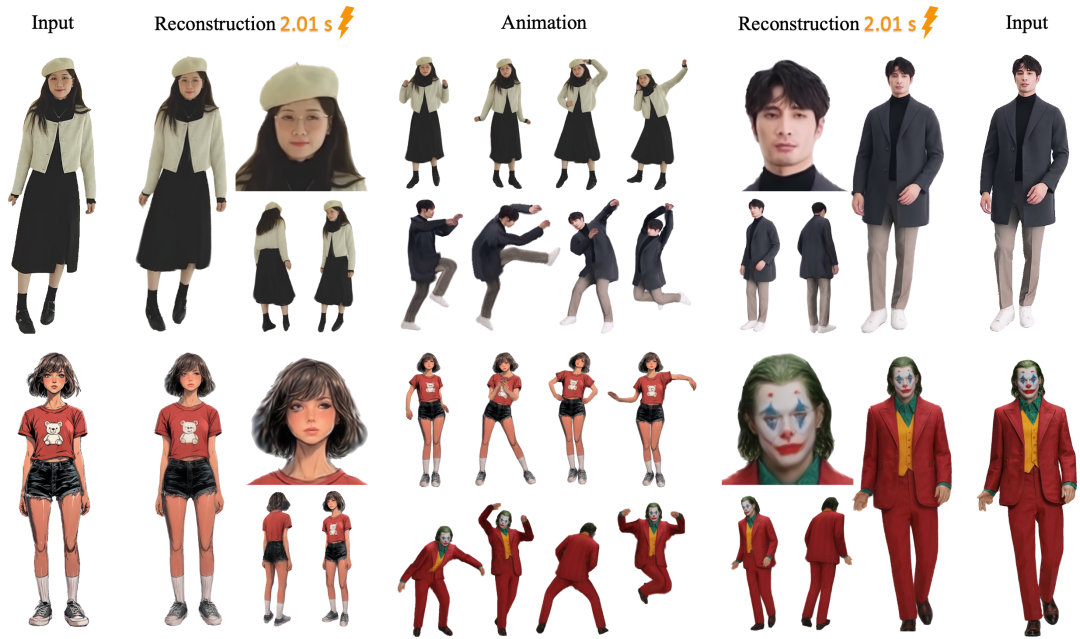

阿里巴巴通义实验室LHM(Large Animatable Human Reconstruction Model),以“单图秒变3D可动模型”的能力,彻底颠覆了这一领域的游戏规则。

简介

LHM是一款基于深度学习的开源工具,仅需单张人物照片即可在2-5秒内生成高精度、可动画驱动的3D人体模型。与传统建模方式相比,它的突破性体现在:

-

零门槛操作: 无需3D扫描仪或多视角拍摄,普通手机照片即可作为输入18 -

实时交互性: 支持通过参数调整或动作脚本实时控制模型姿态与表情46 -

工业级精度: 可还原发丝纹理、衣物褶皱等细节,输出模型可直接用于游戏引擎与影视制作78

技术对比:相较于传统NeRF技术需要多角度图像和长时间计算,LHM通过创新的3D高斯点云表示法(Gaussian Splatting),将重建速度提升10倍以上。

技术架构

1. 多模态Transformer融合

LHM采用Body-Head Transformer架构,分别处理身体与头部的特征:

-

身体建模: 基于SMPL-X人体先验模型,通过Vision Transformer提取2D图像特征,并映射为3D高斯点云的坐标、旋转等参数 -

头部增强: 引入DINOv2网络结构进行多尺度特征提取,通过Head Tokenization机制捕捉面部细节

2. 3D高斯点云渲染

不同于传统网格模型,LHM使用动态高斯球体表示人体:

-

每个高斯点包含位置、颜色、透明度等属性,通过可微分渲染实现实时预览 -

支持与SMPL-X骨骼系统绑定,实现动作驱动的点云形变

3. 自监督训练范式

项目团队创新性地采用视频数据训练模型:

-

通过渲染损失函数优化几何一致性 -

引入“接近球形”正则化约束,防止模型畸形 -

预训练模型LHM-0.5B/1B适配不同显存配置

核心功能

-

快速重建: 在几秒钟内完成从单张图像到3D可动画化模型的转换,无需复杂的后处理 -

高保真细节: 精确保留服装纹理、面部细节等关键信息,生成高质量的3D模型 -

实时动画: 支持基于姿态控制的实时动画渲染,适用于沉浸式应用(如AR/VR) -

泛化能力强: 在开放环境(in-the-wild images)上表现出色,适应多种场景和姿态

部署运行

环境配置

克隆仓库并创建虚拟环境:

git clone git@github.com:aigc3d/LHM.git

cd LHM

python -m venv lhm_env

lhm_env\Scripts\activate

Windows安装

运行安装脚本:

install_cu121.bat

python ./app.py

模型下载

wget https://virutalbuy-public.oss-cn-hangzhou.aliyuncs.com/share/aigc3d/data/for_lingteng/LHM/LHM-0.5B.tar

tar -xvf LHM-0.5B.tar

本地运行

python ./app.py

演示示例

版权声明:

1、本网站名称:帝企吧

2、本站永久网址:https://www.diqiba.com

3、本网站的文章部分内容可能来源于网络及作者投稿,仅供大家学习与参考,如有侵权,请联系站长进行删除处理。

4、本站一切资源不代表本站立场,并不代表本站赞同其观点和对其真实性负责。

5、本站一律禁止以任何方式发布或转载任何违法的相关信息,访客发现请向站长举报。

6、本站资源大多存储在云盘,如发现链接失效,请联系我们我们会第一时间更新。

7、本站所有资源来源于互联网,仅用于学习及参考使用,切勿用于商业用途,如产生法律纠纷本站概不负责! 8、资源除标明原创外均来自网络转载,版权归原作者所有,若侵犯到您权益请联系我们删除,我们将及时处理! 9、若您需使用非免费的软件或服务,请购买正版授权并合法使用!

1、本网站名称:帝企吧

2、本站永久网址:https://www.diqiba.com

3、本网站的文章部分内容可能来源于网络及作者投稿,仅供大家学习与参考,如有侵权,请联系站长进行删除处理。

4、本站一切资源不代表本站立场,并不代表本站赞同其观点和对其真实性负责。

5、本站一律禁止以任何方式发布或转载任何违法的相关信息,访客发现请向站长举报。

6、本站资源大多存储在云盘,如发现链接失效,请联系我们我们会第一时间更新。

7、本站所有资源来源于互联网,仅用于学习及参考使用,切勿用于商业用途,如产生法律纠纷本站概不负责! 8、资源除标明原创外均来自网络转载,版权归原作者所有,若侵犯到您权益请联系我们删除,我们将及时处理! 9、若您需使用非免费的软件或服务,请购买正版授权并合法使用!

评论(0)